Основи інтелектуального аналізу даних: технології, методи і завдання

Використання даних є проблемою при складанні програм і розробки інформаційних систем. Перш ніж виконати аналіз великого обсягу даних і прийняти рішення, що гарантує достовірний і об'єктивний результат, необхідно визначити цей великий обсяг. Завдання ускладнюється, якщо потік інформації стрімко зростає, а час на прийняття рішення обмежений.

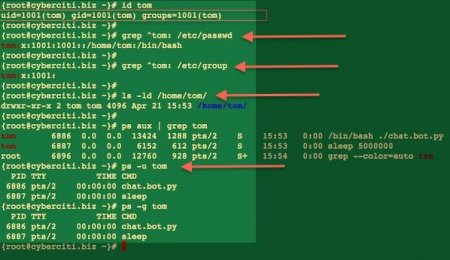

Технології інтелектуального аналізу даних на цьому рівні практично бездоганні. Тип даних може бути відомий до моменту операції над ними, а в разі невідповідності - буде автоматично приведений до потрібного типу. Розвинені інструменти гіпертексту, повсюдно використовується розподілена обробка великих обсягів даних. На цьому рівні: інформаційні завдання піддаються формалізації; потреби до інтелектуального аналізу задовольняються; якість результату залежить від якості знань і професіоналізму програміста. Ситуація в програмуванні інформаційних систем рівня підприємства характеризується наявністю реально працюючих продуктів, що забезпечують формування великих обсягів даних і проблему більш високого порядку.

На практиці нова область знань придбала міждисциплінарний характер та перебуває у стадії становлення. Завдяки досвіду та програмної продукції від Oracle, Microsoft, IBM та інших лідируючих компаній склалося чітке уявлення про те, що таке інтелектуальний аналіз даних, але питань ще дуже багато. Досить сказати, що лінійка програмних виробів від Oracle, присвячена виключно великих обсягів інформації, їх інтеграції, сумісності, міграції та обробці - це більше сорока позицій! Що потрібно, щоб поставити задачу обробки великих даних правильно і отримати обґрунтоване рішення? Вчені та практики сходяться на узагальненому розумінні фрази «пошук прихованих закономірностей». Тут поєднано три позиції: неочевидність; об'єктивність; практична корисність. Перша позиція означає, що звичайними методами не визначити, що потрібно знайти і як це зробити. Класичне програмування тут не застосовується. Потрібен якщо не штучний інтелект, то хоча б програми для інтелектуального аналізу даних. Термін «інтелектуального» являє собою не меншу проблему, чим задача визначення достатнього обсягу початкових даних для прийняття рішень і формулювання вихідних правил роботи. Об'єктивність - свого роду гарантія, що обрана технологія, розроблена «інтелектуальна» методика або спектр «інтелектуальних» правил дадуть підставу вважати отримані результати правильними не тільки автору, але і будь-якого іншого спеціаліста.

Oracle в своїх програмних виробах додає до поняття об'єктивність статус безпечного, позбавленого стороннього негативного втручання. Практична корисність - найважливіший критерій для результату і алгоритму рішення завдання інтелектуального аналізу даних в конкретному застосуванні.

Інформаційні технології зробили заявку на наукову дисципліну, і не слід гребувати невеликими кроками в новому, незвіданому напрямку. Зазіхнувши на святая святих - природний інтелект, людина не може вимагати від себе того, що зробити не в змозі. Вирішити, що робити і де це робити, на сьогоднішній день вкрай важко. На конкретному бізнесі, в конкретній сфері людської діяльності можна окреслити обсяг інформації, що підлягає дослідженню, і отримати рішення, яке буде характеризуватися якоюсь часткою вірогідності і показником об'єктивності.

Дані та їх формалізація

Сучасні інформаційні технології гарантують безпечний і надійний аналіз, подання та обробку даних. Синтаксично і формально це вірно. З точки зору семантики завдання та об'єктивності очікуваного рішення - результат залежить від досвіду, знань і умінь програміста. Мови програмування перебувають у статусі надійного і безпечного інструменту. Знання й уміння фахівців аналізувати, представляти і обробляти дані прийшли до рівня відносній універсальності.Технології інтелектуального аналізу даних на цьому рівні практично бездоганні. Тип даних може бути відомий до моменту операції над ними, а в разі невідповідності - буде автоматично приведений до потрібного типу. Розвинені інструменти гіпертексту, повсюдно використовується розподілена обробка великих обсягів даних. На цьому рівні: інформаційні завдання піддаються формалізації; потреби до інтелектуального аналізу задовольняються; якість результату залежить від якості знань і професіоналізму програміста. Ситуація в програмуванні інформаційних систем рівня підприємства характеризується наявністю реально працюючих продуктів, що забезпечують формування великих обсягів даних і проблему більш високого порядку.

Великі обсяги даних

У 80-ті роки, коли бази даних ставали системами управління базами даних, підвищення надійності апаратного забезпечення і якість мов програмування залишали бажати кращого. В даний час накопичилося велика кількість баз даних, багато комп'ютеризовані джерела інформації, розроблені складні системи збору різноманітної інформації (фінанси, погода, статистика, податки, нерухомість, персональні дані, клімат, політика). Деякі джерела даних характеризуються очевидними закономірностями і піддаються аналізу математичними методами. Можна виконати інтелектуальний аналіз даних в Excel: очистити дані, побудувати модель, сформувати гіпотезу, визначити кореляції і т. д. У деяких даних та джерела закономірності важко виявити. У всіх випадках програмно-апаратне забезпечення для обробки даних характеризується надійністю і стабільністю. Завдання інтелектуального аналізу даних стала на чолі кута в багатьох соціально-економічних сферах. Лідери інформаційної галузі, зокрема Oracle, фокусують свою увагу на спектрі обставин, що характеризують дані нового типу: величезні потоки; природна інформація (навіть якщо вона створена програмно); різнорідні дані; найвищі критерії відповідальності; широкий спектр форматів представлення даних; сумісність інтеграторів даних та їх обробників. Головна особливість даних нового типу: величезний обсяг і швидкість наростання цього обсягу. Класичні алгоритми не застосовні для обробки даних нового типу навіть з урахуванням швидкодії сучасних комп'ютерів і застосування паралельних технологій.Від бекапа до міграції та інтеграції

Раніше була актуальна задача безпечного зберігання інформації (бекап, резервне копіювання). Сьогодні актуальна проблема міграції множинних уявлень даних (різні формати і кодування) і їх інтеграції в єдине ціле. Без технології інтелектуального аналізу даних багато завдання не вирішити. Тут мова не йде про прийняття рішень, визначенні залежностей, створення алгоритмів вибірки обсягів даних для подальшої обробки. Злиття різнорідних даних стало проблемою, і привести джерела інформації до єдиного формализованному основи немає можливості. Інтелектуальний аналіз даних великого обсягу вимагає визначення цього обсягу і створення технології (алгоритму, евристик, наборів правил) для отримання можливості поставити задачу і розв'язати її.Data mining: що копати

Поняття аналізу даних у контексті інтелектуальних методів почало активно розвиватися з початку 90-х років минулого століття. Штучний інтелект до цього часу не виправдав надій, але необхідність у прийнятті обґрунтованих рішень на основі аналізу інформації стала стрімко зростати. Машинне навчання, інтелектуальний аналіз даних, розпізнавання образів, візуалізація, теорія баз даних, алгоритмізація, статистика, математичні методи склали спектр завдань нової, активно розвивається галузь знань, яку асоціюють з англомовним data minig.На практиці нова область знань придбала міждисциплінарний характер та перебуває у стадії становлення. Завдяки досвіду та програмної продукції від Oracle, Microsoft, IBM та інших лідируючих компаній склалося чітке уявлення про те, що таке інтелектуальний аналіз даних, але питань ще дуже багато. Досить сказати, що лінійка програмних виробів від Oracle, присвячена виключно великих обсягів інформації, їх інтеграції, сумісності, міграції та обробці - це більше сорока позицій! Що потрібно, щоб поставити задачу обробки великих даних правильно і отримати обґрунтоване рішення? Вчені та практики сходяться на узагальненому розумінні фрази «пошук прихованих закономірностей». Тут поєднано три позиції: неочевидність; об'єктивність; практична корисність. Перша позиція означає, що звичайними методами не визначити, що потрібно знайти і як це зробити. Класичне програмування тут не застосовується. Потрібен якщо не штучний інтелект, то хоча б програми для інтелектуального аналізу даних. Термін «інтелектуального» являє собою не меншу проблему, чим задача визначення достатнього обсягу початкових даних для прийняття рішень і формулювання вихідних правил роботи. Об'єктивність - свого роду гарантія, що обрана технологія, розроблена «інтелектуальна» методика або спектр «інтелектуальних» правил дадуть підставу вважати отримані результати правильними не тільки автору, але і будь-якого іншого спеціаліста.

Oracle в своїх програмних виробах додає до поняття об'єктивність статус безпечного, позбавленого стороннього негативного втручання. Практична корисність - найважливіший критерій для результату і алгоритму рішення завдання інтелектуального аналізу даних в конкретному застосуванні.

Data mining: де копати

Бізнес-інтелект (Business Intelligence - BI) - основа сучасного, найдорожчого і затребуваного програмного забезпечення. Постачальники бізнес-рішень вважають, що знайшли спосіб вирішення задач по обробці великих обсягів даних, і їх програмні вироби можуть забезпечити безпечне і стрімкий розвиток бізнесу компанії будь-якого розміру. Як у випадку штучного інтелекту в області кошти інтелектуального аналізу даних, не слід занадто сильно перебільшувати поточні досягнення. Все тільки стає на ноги, але і заперечувати реальні результати теж не можна. Питання сфери застосування. Розроблені алгоритми інтелектуального аналізу даних в економіці, на виробництві, у галузі інформації про клімат, про курси на валютній біржі. Існують інтелектуальні продукти для захисту підприємства від негативного впливу звільнених працівників (область психології і соціології - сильна тема), від вірусних атак. Багато розробки реально виконують функції, які задекларовані їх виробниками. Фактично завдання - що робити і де це робити - придбала осмислений і об'єктивний контекст: мінімально можлива область застосування; максимально точна і чітка мета; джерела даних і дані, приведені до однієї основи. Тільки область застосування і очікувана практична корисність можуть допомогти сформулювати технології, методики, правила і основи інтелектуального аналізу даних в конкретній сфері, задля конкретної мети.Інформаційні технології зробили заявку на наукову дисципліну, і не слід гребувати невеликими кроками в новому, незвіданому напрямку. Зазіхнувши на святая святих - природний інтелект, людина не може вимагати від себе того, що зробити не в змозі. Вирішити, що робити і де це робити, на сьогоднішній день вкрай важко. На конкретному бізнесі, в конкретній сфері людської діяльності можна окреслити обсяг інформації, що підлягає дослідженню, і отримати рішення, яке буде характеризуватися якоюсь часткою вірогідності і показником об'єктивності.

Data mining: як копати

Професійне програмування і власний висококваліфікований персонал - єдиний інструмент для досягнення бажаного. Приклад 1. Завдання інтелектуального аналізу даних не буде вирішена чистим застосуванням Oracle Load Testing Controller. Цей продукт заявлений як повнофункціональний і розширюваний інструмент тестування навантаження. Це вкрай вузька завдання. Тільки навантаження! Нічого більше, ніяких високоінтелектуальних завдань. Проте завдання, на яких застосовується даний продукт, можуть поставити в безвихідь не тільки тестувальника, але і розробника, при всіх регаліях лідера галузі. Зокрема, тестування - це вимога функціональної повноти. Де гарантія, що Oracle Load Testing Controller «в курсі», які набори даних можуть надходити на вхід досліджуваного програми, сервера, програмно-апаратного комплексу. Приклад 2. Oracle Business Intelligence Suite Foundation Edition for Oracle Applications - розробник декларує цей продукт як вдале поєднання використовується з експертними знаннями побудови, розвитку та забезпечення великого бізнесу. Безперечно, досвід Oracle великий, але цього не достатньо для його трансформації через програмно-експертне виріб. На конкретному підприємстві, в конкретному регіоні Business Intelligence від Oracle може не спрацювати від рішення податкової служби або ухвали місцевого муніципалітету.Розумне застосування сучасних технологій

Єдине правильне рішення в області великих обсягів інформації, data mining і системи інтелектуального аналізу даних компанії, державній установі і в будь-якій соціально-економічній сфері - колектив фахівців. Знання і досвід кваліфікованих фахівців - це єдино правильне рішення, яке дасть комплексний відповідь на питання: data mining: що копати, де це робити і як? Придбати пріоритетні продукти відповідного призначення зайвим не буде, але перш ніж це робити, потрібно вивчити область застосування, сформулювати орієнтовний рішення і поставити попередню мета. Тільки після того, як предметна область визначена мета і приблизно зрозуміла, можна зайнятися пошуком вже розроблених і перевірених практикою рішень. Швидше за все, буде знайдений продукт, який дозволить уточнити предметну область і мета. Ніяка програма сьогодні не впорається з реальною задачею. Програвши в області штучного інтелекту на початку 80-х років минулого століття, людина-розумний ще не може розраховувати, що здатний написати програму, вирішальну інтелектуальні завдання. Не слід сподіватися, що ШІ прийде сам, а куплена у Oracle, Microsoft і IBM програма скаже, що потрібно було робити, як і який результат вважати правильним. У сучасному світі інформаційних технологій йде бурхливий прогрес. В ньому можна прийняти ефективне участь, посилити позиції свого бізнесу або розв'язати задачу, яку важко було поставити. Але потрібно брати участь, а не розраховувати на програму. Програмування - це статичний працю, його результат - жорсткий алгоритм. Сучасне інтелектуальне правило або евристика - це жорстко поставлене рішення, яке не спрацює при першій-ліпшій нагоді.Моделювання і тестування

Інтелектуальний аналіз великих даних - дійсно затребувана і актуальне завдання. Але область застосування до виявлення цієї задачі худо-бідно, але жила і розвивалася. Необхідність у подальшому розвитку бізнесу ставить нові завдання, які дозволяють концептуально окреслити обсяги підлягають обробці великих даних. Це природний процес науково-технічного та інтелектуального розвитку підприємства, компанії, бізнесу. Це ж можна віднести до інтернет-технологій, до завдань парсинга інформації на просторах інтернету. Існує безліч нових завдань і програм, які затребувані, можуть бути більш-менш чітко поставлені і характеризуються об'єктивним параметром: у їх вирішенні є затребуваний інтерес і є розуміння вірогідною корисності. Моделювання - досить розроблена область, яка оснащена безліччю перевірених математичних методів. Модель можна побудувати завжди, був би час і бажання. Моделювання дозволяє сфокусувати всі наявні знання в одну систему і вдосконалювати її на наборі тестових даних циклічно. Це класичний шлях розвитку, який також пройшов перевірку практикою. Якщо не будувати повітряних замків, а зі стабільною впевнено йти до поставленої мети, то можна визначити і шлях, і бажане рішення, і кінцеву мету.Програмування та інтелектуальні методи

Саме програмування на початку 80-х років минулого століття підштовхнуло суспільну свідомість до народження ідей штучного інтелекту, саме воно стало родоначальником data mining, і саме з нього почалися методи інтелектуального аналізу даних. У ті далекі часи проблеми великих обсягів даних не існувало. Сьогодні є не тільки великі обсяги даних, але і результат розвитку систем управління базами даних - значний досвід у реляційних відношеннях, як основі засад для подання даних. Реляційні відносини - це частина, але не ціле. Є ще поняття системності, ієрархії і багато того, чим володіє природний інтелект, але не може реалізувати штучний інтелект: в даному випадку - в програмуванні. Програмування не є інтелект ні в якому сенсі, але це реальний результат застосування інтелекту на практиці. У цьому його зміст, і саме це можна використовувати у досягненні бажаних цілей.Активні знання і вміння

Будь-яка програма - це статика. Вона являє собою конструювання алгоритму рішення задачі в рамках синтаксису мови програмування. Сучасні мови програмування - досконалий результат 80-х років, і це ніяк не можна заперечувати. Не можна також не зауважити, що сучасні мови програмування дають можливість створювати вільні алгоритми за межами свого синтаксису. Якщо хто-небудь коли-небудь зможе написати програму, яка буде працювати не з волі її автора, а з волі набутих нею знань і умінь, проблема великих обсягів даних і прийняття інтелектуальних рішень буде закрита, і почнеться новий виток розвитку знань.Цікаво по темі

Зміст і використання JavaScript void

Відсутність значення і значення undefined - раритет найдавніших часів інформаційних технологій, але навіть в сучасному світі у них є місце і

Перевірка наявності файлу PHP file_exists

Широке застосування баз даних не позбавило звичайну файлову систему значення. Запис і читання файлів як і раніше займають значиме місце в

Інформаційно-аналітична система і її створення

Інформаційні технології в наші дні особливо стрімко розвиваються. Це дозволяє удосконалити процедури управління і, тим самим, підвищити якість

Що таке парсинг: мета і логіка

Обробка інформації характеризується динамікою вихідних даних або необхідністю обробки даних з різних джерел за алгоритмами. В обох випадках